在世人對AI的「邪惡性」進行攻詰的浪潮中,AI造假,可能已經是現在排首位的理由了。本文我們就從「深度偽造」到「深度合成」,來談談AI為啥需要一次「正名」?

自從2017年Deepfake(深度偽造)橫空出世以後,人們驚呼原來AI在造假方面簡直天賦異稟。此後「AI生成內容」技術,特別是GAN演算法的突飛猛進更加印證了這一事實。不僅僅是AI換臉,還有AI自動生成文本、語音、圖像、視頻等等一切數字內容。

除了AI換臉帶來的色情視頻泛濫之外,人們更進一步擔心AI生成內容技術在隱私侵犯、威脅信息安全、操縱政治選舉等方面帶來全新挑戰。

人們往往會假設,如果任由AI生成的內容在互聯網中蔓延,將會更進一步沖毀互聯網世界的真實性邊界。

(被AI造假的扎克伯格「諷刺」自己的Facebook平台)

Deepfake之後,真相何在?

如果哪些是真,哪些是假,普通人都難以分辨的時候,那麼組成社會基石的真相和信任將就此坍塌,但我們似乎還沒有做好活在「無信任社會」的準備吧。

德國哲學家康德在《實踐理性批判》中論證「人為什麼不能說謊」的法則,揭示了「無信任社會」的悖論和荒謬。

假如「人人可以說謊」是一條社會的通行法則,那麼,每個人都不會再信任另一個人說的話,這樣說話人的謊言也就不會得逞。說謊而無人相信,就陷入了自相矛盾的境地,反之「人人不能說謊」,才應該是正常社會的通行法則。

這就是說,只有在默認「人人應該誠實」的信任社會裡,說謊者才可以通過成功騙到他人獲利,也會因為謊言被戳穿而信譽破產。而在「無信任社會」中,信息的真假判斷都難以進行,那隻能默認一切都為「假」,才會不至於上當受騙。但是相應的代價是信任全無,合作難以達成,交流也不再可能,最終將會是社會的分崩離析。

當然這只是理論上面最極端的演繹。現實世界永遠會在理論世界之下形成巨大的灰色空間,人性的基石仍將亘古不變,技術的演進也會一往無前,而人性的弱點就會在這兩者的撕扯的張力中一直暴露無遺。每一代的新人類除了持續的學習、進化,以適應技術加速帶來的全新挑戰,似乎也沒有什麼更好的辦法。

回到「Deepfake」為代表的「AI生成內容」技術來說,它既不會成為將我們的社會拖向「無信任」的深淵,也不會讓我們的人性變得更好或更壞一點。在一個即將到來的「虛實相容、真假不分」的后真相世界當中,只會讓適應這一變化的我們變得更加複雜和反脆弱。

所以。這一略帶「貶義」的Deepfake(深度偽造)的技術名詞,需要被我們重新塑造為一個技術中性辭彙——Deep Synthesis(深度合成)。

為「深度合成」正名:AI的技術中性

科技的每一次突破,都可能帶來意想不到的「副產品」。就如同愛因斯坦發現了質能方程式之後,即使再不情願,他也無法阻止原子彈的出現和使用。就在Deepfake這個「妖孽」在美國新聞網站Reddit被放出來之後,AI的領軍人物Yann LeCun也在Twitter上深深反省:

「說真的,要是當初知道卷積神經網路(CNN)會催生Deepfake,我們還要不要發表它?」

隨即LeCun自己就回答了這個問題。LeCun表示,即使不是我們首先公開發表,CNN也會由其他人或機構發明出來。而在2002年當時被公布出來以後,人們也不知道如何來利用它。

換句話說,CNN的價值要在技術人員的不斷探索下才能挖掘出來。現在CNN正在被開發出各種各樣的應用,既對世界有很多正向的積極影響,比如醫療診斷、自動駕駛、內容過濾以及安全監控等等,也可能引起一些負面的效果,比如侵犯隱私、造假詐騙、偏見歧視等等,好壞參半,可以各打五十大板。

簡單來說,就是AI無罪,問題還是出在使用AI技術的人類身上。

以Deepfake技術所引發的AI換臉的色情視頻泛濫來說,AI技術被應用於色情產業幾乎是一件「必然如此」的過程。一方面,現代色情產業一直都是最新科學技術應用的急先鋒,另一方面,AI在圖像內容生成技術的發展正好迎來了突破臨界點。最後一步就只剩下這個叫「Deepfakes」的用戶最後的「靈機一動」了。

實際上,Deepfake為「AI內容生成」技術的普及起到了推波助瀾的作用,但同時也帶來難以抹去的污名化影響。而鑒於「AI內容生成」技術的發展早已超出AI換臉的範疇,技術商業領域正在試圖用「深度合成」來為這一技術正名。

首先,Deepfake(深度偽造)一詞明顯以偏概全,其僅僅是「AI換臉」技術的早期代表,不足以包含所有的「AI生成內容」的技術。用Deep Synthesis(深度合成)可以更好地泛指所有AI生成演算法和涵蓋自動生成圖像、視頻、語音、文本、音樂等內容的合成技術。

其次,Deepfake尚未得到技術社區的廣泛認可,只是被媒體大眾叫順嘴了而已。況且Deepfake自帶的「腹黑」體質,對於AI技術的應用推廣會帶來直接的負面影響。

「深度合成」這個更為中性的技術名稱,將會代替Deepfake來行使AI內容發展的應盡之責。那麼,「深度合成」該如何撐起這重任呢?

「深度合成」的底氣:技術加速和商業落地

「深度合成」技術,其實就是藉助可以自主學習的深度學習演算法模型來實現的,其主要使用的的兩個技術就是「自動編碼器」人工神經網路和 「生成對抗網路」(GAN)的人工神經網路組成。

前者用於訓練數據的合成,後者由生成器和鑒別器組成,一個用來進行新數據的生成和一個用來對其進行鑒別,經過二者無數次的對抗,最終生成出「以假亂真」的合成數據,其中就包括Deepfake所創造出來的換臉視頻。

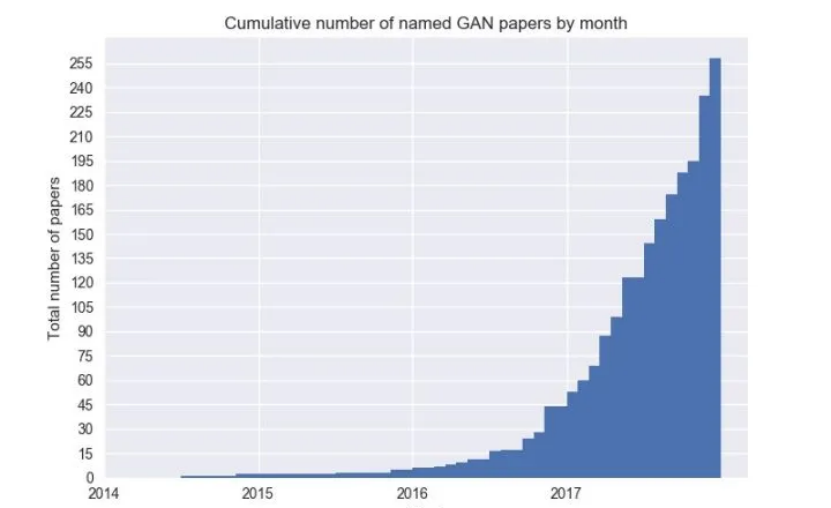

(GAN相關論文的發表情況)

從2014年,GAN提出一直到今天,已經經歷了從CGAN、BigGAN 、StyleGAN等多個版本更新,其中每年的相關研究論文也在加速增長,可見學界對於GAN演算法的重視和發展前景的看好。

(BigGAN 生成的包含各種類別的高清晰圖片)

與此相應的,就是圖像生成質量的突飛猛進,其中不僅可以實現人臉的合成,也能更一步實現圖像疊加融合,或者直接生成全新的高清圖片,以致於人眼根本難以分辨真假。

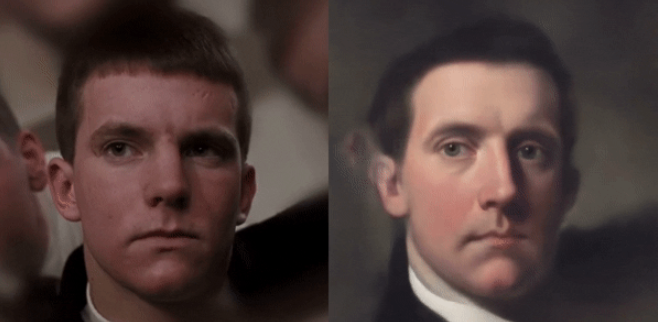

比如,去年MIT和IBM沃森聯合實驗室發布的一個基於GAN的AI藝術畫師,就可以學習文藝復興時期的畫家的繪畫風格,直接將現代人類的照片變成文藝復興時期的畫作。

其中的技術優勢在於,GAN神經網路會根據自己學到的技巧為畫面重新構圖,也就是它是畫出新的圖片,而不是利用風格遷移的方式,改變原圖的色彩。

其實,深度合成技術已經可以走得更遠。除了單一的圖像、音頻合成之外,多維度的內容合成已經是一個趨勢,這樣可以將語音識別、人臉識別、唇形搜索等結合起來,進行人臉語音的合成,從而可以讓一個人自然流利地說出自己從未說過的話。

此外,人臉合成之外,全身合成、3D合成虛擬人技術也成為當前的應用熱點。剛剛過去的兩會期間,搜狗聯合新華社推出上崗的全球首個3D版AI合成主播,就已經可以在文本實時驅動面部表情和唇形,肢體動作、超寫實細節呈現上面做到比擬真人的動態效果。

在「深度合成」技術的商業化方面,已經有眾多行業和企業看到其應用場景和廣闊市場。目前,「深度合成」已經在影視娛樂、社交通訊等多個行業的場景中開始發揮作用。

比如,在影視劇製作中,最直接的幫助就是提升音視頻製作的效率,拓展創作想象空間。一些特殊情況下,還可以通過合成技術為影視劇的失聲的演員進行聲音合成,為已過世的演員進行「數字復活」,甚至直接創造虛擬數字人來進行影視劇集的製作。

在娛樂應用體驗上面,最基本的臉部特效應用、換臉視頻、動圖,都已經多次在我們的生活中出現;虛擬偶像、虛擬主播、虛擬客服也隨著深度合成技術的成熟而變得越逼真和可信。

在社交通訊上面,與其擔心深度合成技術會暴露個人隱私,不如可以讓深度合成技術幫我們在社交網路中建立自己的「數字分身」,就如同《頭號玩家》裡面每個人創建的虛擬形象一樣,成為自己在網路世界的通行證。

此外,像電商營銷、教育藝術、醫療科研等領域,深度合成技術帶來的模擬數據和虛擬化內容都可以為這些產業帶來新的應用場景或者直接推動該領域的技術進步。

顯然,深度合成技術的這些正向價值正在為其換來更有底氣的話語權和發展前景。但是這個一出現就飽受人類質疑和恐懼的AI技術,仍然值得我們認真對待其應用邊界和規則。

「深度合成」的治理:如何鎖住「虛假內容」的惡龍

正如一切獲得都必須付出代價一般,我們如果想要享受深度合成技術帶來我們的一切生活便利和精神享受,同時就必須承受其帶來的將數字世界全面虛擬化的代價。深度合成技術所帶來的「虛假內容」的社會風險將長期存在。

- 首先,深度合成的開源技術和軟體,讓普通人們偽造、操縱音視頻的門檻大幅降低;

- 其次,這些虛假音視頻內容足以以假亂真地騙過大多數「不明真相」的群眾;

- 最後,這些帶有明顯色情、危言聳聽或侵犯隱私的信息又足以吸引人,只要從源頭傳出,就會進行源源不斷的擴散。

除了少數能夠辨別真偽的專業人士,大多數人都難以分辨和抵制這些假信息的誘惑。深度合成的技術濫用風險,需要得到來自法律、技術、行業、民眾等多方面的制約。

- 第一,法律層面。對AI深度合成內容的用途、標記、使用範圍以及濫用技術的處罰,都應該進行深入研究,並出台相應的規定,為深度合成的合法使用提供依據。

- 第二,技術層面。與深度合成技術同步進化的內容鑒別技術和溯源追蹤技術也應該得到重視。針對合成內容的有效鑒別與標記,才能從源頭來識別合成內容,以防止負面的虛假內容的擴散。

- 第三,行業層面。深度合成技術離不開行業自律,合成內容技術提供者和平台要承諾在合成內容之上必須做出標記,或者提供有效的檢測和標註工具,來保證合成內容被清晰識別出來。

- 最後,民眾層面。相比較於權威機構或者主流精英人群對合成內容泛濫的擔憂,廣大民眾反而可能是這波「虛擬化」浪潮最主要的支持者,甚至是虛假信息的推波助瀾者。

在我們即將全面迎來數字化世界的今天,培養合格「數字素養」應該要成為一件從小就抓起的公民必修課。但這門課教什麼、怎麼上,仍然需要在深度合成技術發展的路上慢慢探索。

正如沒有任何一個技術是我們在做好準備之後才出現,AI技術也是如此。從一開始,我們就把AI技術出發點定義為,儘可能地學習和模仿人類的能力,以致於最終能夠代替人類行駛那些繁重、重複甚至極高難度的任務。

而深度合成技術不正是這一目標的實現過程。我們既然選擇喚醒AI這條巨龍,就不能再「葉公好龍」地擔心AI越來越像人類這件事情。

最後,反過來看我們人類這個物種,一方面我們有極致的智慧去探索世界的因果規律,始終去探索那個「真相」;一方面我們又抱著極大熱情來發明各種工具,來承擔人類的各種工作。

這兩種能力也直接促成了我們今天的工業世界,以及未來要進入的數字虛擬世界。

樂觀來說,我們不僅不用太過擔心「后真相時代」的來臨,甚至於,我們還會很快適應這個徹底「虛擬化」的美麗新世界。

對於絕大多數人來說,追求真相,遠遠沒有追求舒適更具吸引力。

作者:腦極體,微信公眾號:腦極體